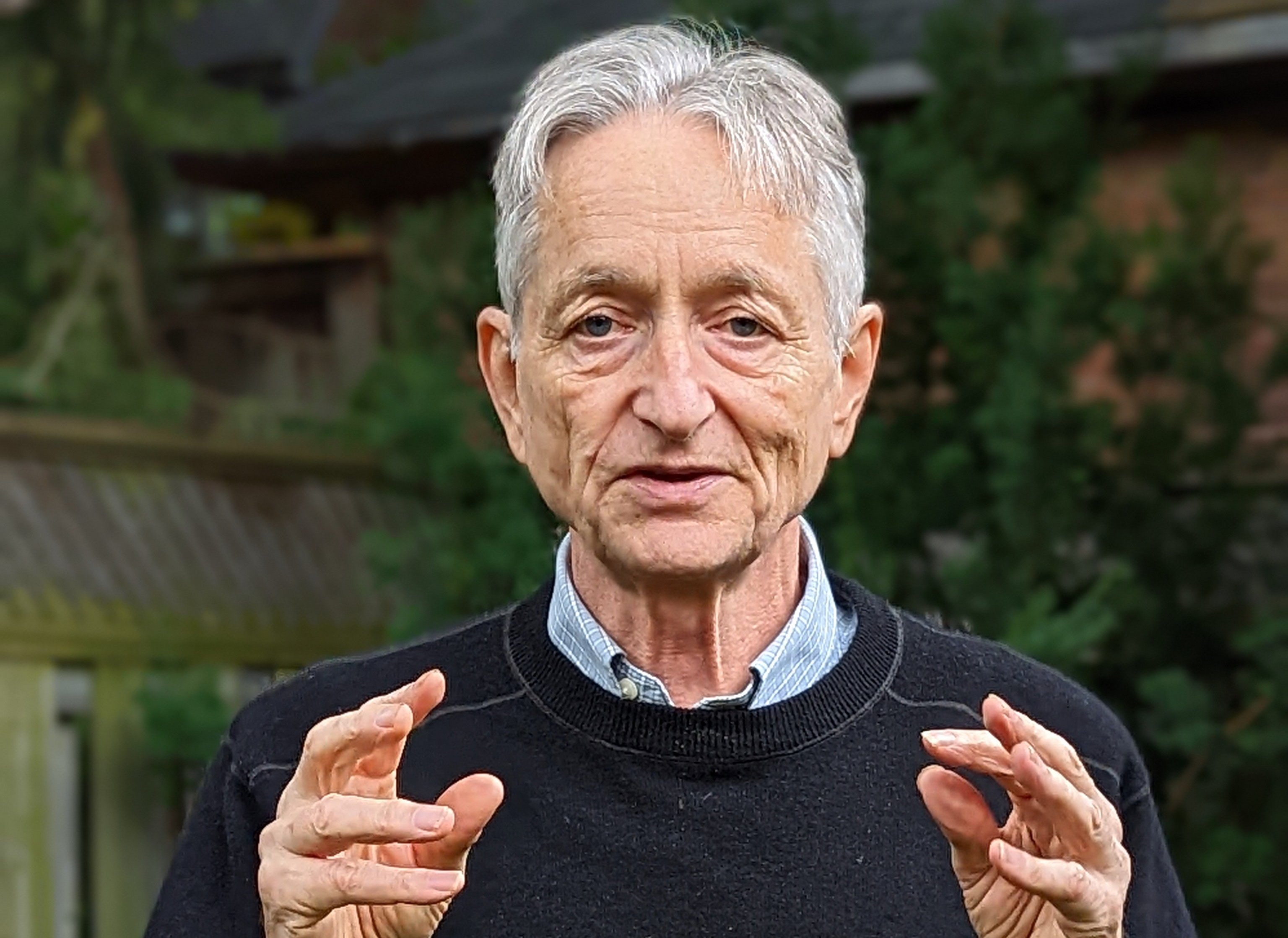

Pionnier de l'intelligence artificielle, le chercheur Geoffrey Hinton a quitté Google pour alerter sur les "risques de l'IA pour l'Humanité". Une prise de position alarmiste qui ne fait pas l'unanimité.

On le surnomme « le parrain de l’IA » car il est l’un des pionniers de la recherche en intelligence artificielle. Âgé de 75 ans, Geoffrey Hinton est un ponte de la recherche en IA. Il a même reçu en 2019 le prix Turing, la plus haute distinction en informatique, pour ses travaux sur les réseaux de neurones, à la base de beaucoup de systèmes d’IA actuels

Le risque d'une IA généraliste

A court terme, dit-il encore, l'IA va apporter beaucoup plus d'avantages que d’inconvénients. Mais à plus long terme, les risques seraient énormes. Derrière cela, se profile le rêve – ou le cauchemar –de ce que l’on appelle une Intelligence Artificielle Générale (IAG). Ce que craint surtout le chercheur, ce sont les « mauvaises » utilisations de l’IA. Il évoque le scénario d’une IAG entre les mains d’un Vladimir Poutine, par exemple, auquel cela pourrait donner un pouvoir surdimensionné afin de mener à bien toutes sortes de plans.

Cette étonnante confession de Geoffrey Hinton rappellerait presque les regrets de Robert Oppenheimer, le père de la bombe atomique, qui démissionna et exprima son épouvante après Hiroshima et Nagasaki.

Pessimistes contre optimistes

Voilà qui rallume les craintes évoquées récemment dans la fameuse pétition réclamant un moratoire sur l’IA, signée par plusieurs milliers de personnes, dont des scientifiques et des personnalités comme Elon Musk ou le chercheur québécois Joshua Bengio.

Tous, en tout cas, appellent à plus de régulation des applications à base d'intelligence artificiel.

La question de fond est la suivante : comment faire pour que l’IA ne soit pas la bombe atomique de demain ? Comment poursuivre la recherche en IA sans aller vers l’apocalypse que certains nous prédisent ? C’est probablement l’un des plus grands défis des années à venir.