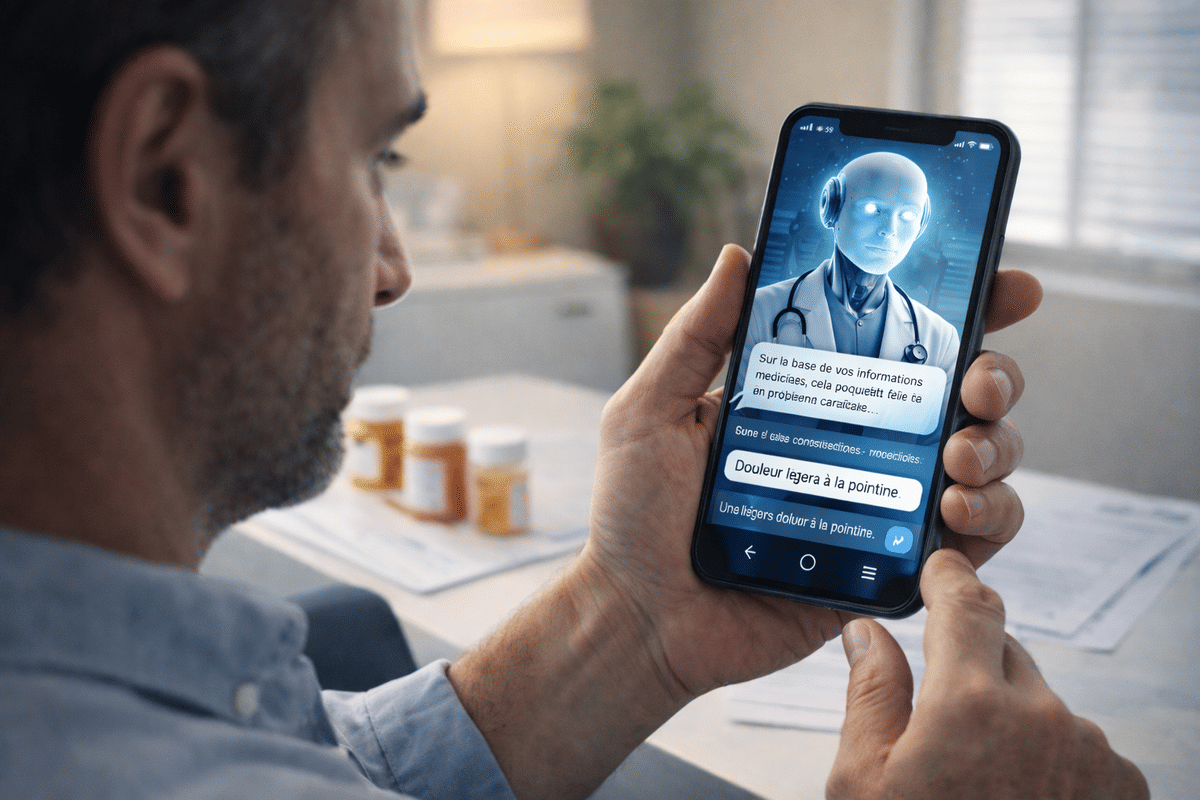

Alors que l'intelligence artificielle s’impose comme un véritable assistant médical du quotidien, OpenAI et Anthropic lancent des services dédiés à la santé.

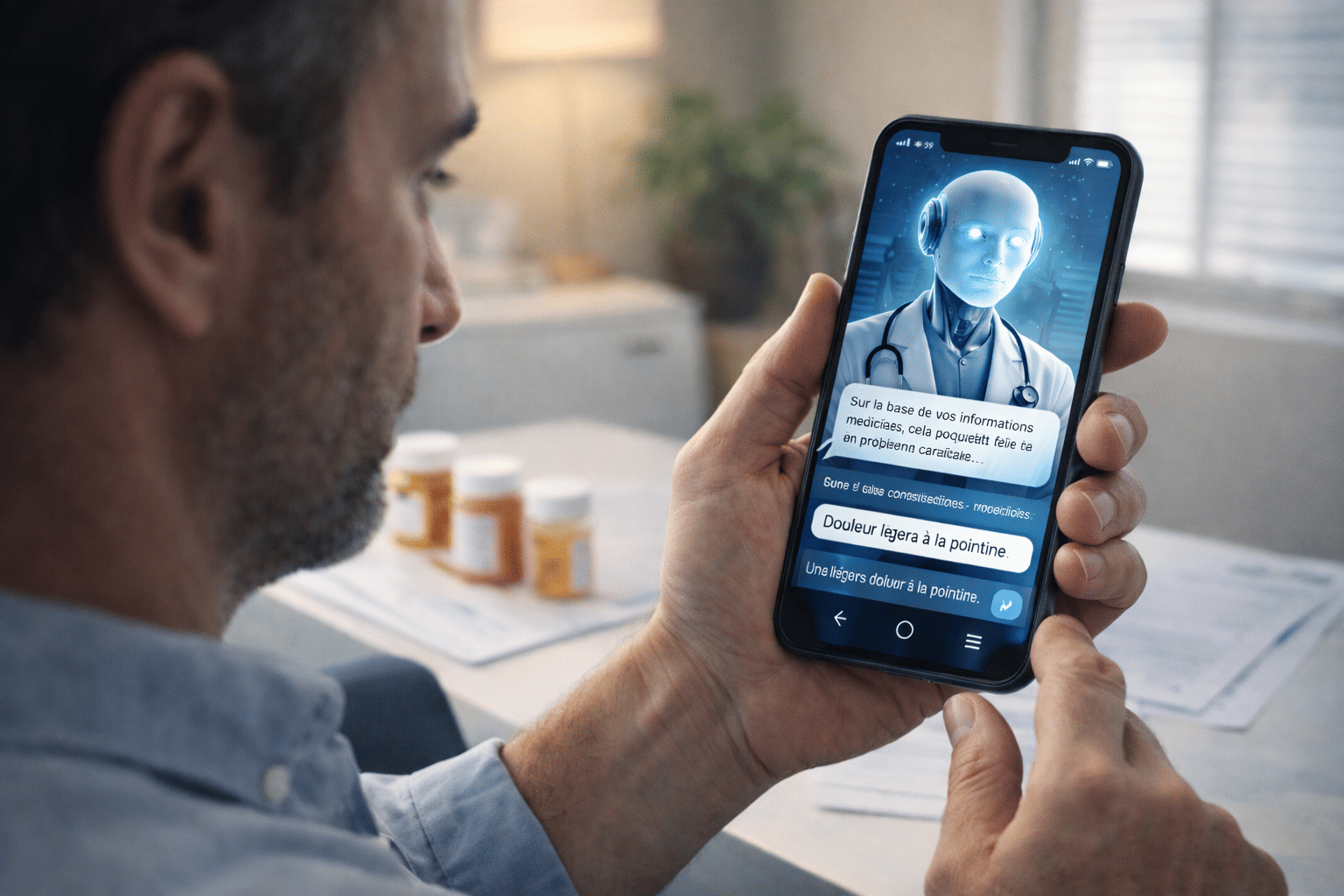

De plus en plus de personnes autour de moi me disent qu’elles confient leurs résultats d’analyses médicales à ChatGPT, seul moyen pour un humain n’ayant pas fait des années de médecine ou de biologie de comprendre ce que signifient ces colonnes de chiffres et de termes abscons. Beaucoup interrogent aussi, de plus en plus souvent, leur chatbot préféré au moindre bobo.

Bref : ça y est, l’IA est en train de devenir un vrai médecin de famille, notre premier contact santé.

Un vrai conseiller santé

Ce mouvement, qui pouvait encore sembler marginal il y a quelques mois, est désormais assumé par les géants de l’IA eux-mêmes qui viennent de lancer des offres dédiées.

OpenAI a dévoilé ChatGPT Santé, un ensemble de fonctionnalités capables d’analyser des documents médicaux, de suivre des données personnelles dans le temps, et d’aider à la compréhension des diagnostics ou des parcours de soins; tout en ayant la possibilité d’intégrer leurs propres données médicales ou de bien-être (dossiers médicaux, données d’applications diverses).

De son côté, Anthropic emboîte le pas avec Claude for Healthcare, des solutions orientées vers l’assistance clinique et l’accompagnement des patients, tout en promettant une approche “responsable” et encadrée. Déployées en version bêta aux États-Unis pour les abonnés Pro et Max, ces fonctionnalités s’inscrivent dans une logique de personnalisation, tout en revendiquant des garanties strictes en matière de confidentialité.

Fidji Simo "sauvée" par ChatGPT ?

Les bénéfices paraissent évidents : à l'heure où l'accès aux soins devient de plus en plus compliqué, c'est un moyen de trouver tout de suite un interlocuteur à même de nous informer; et aussi de nous rassurer - étonnamment, ChatGPT sait mettre les formes lorsqu'il explique une pathologie ou interprète des résultats d'analyses.

Au récent CES de Las Vegas, on m'a rapporté cette anecdote concernant Fidji Simo, la patronne des produits d'OpenAI, qui aurait évité qu’on lui administre un traitement inapproprié en interrogeant ChatGPT auquel elle a depuis longtemps confié tout son historique médical. L’outil aurait détecté une incohérence que les médecins n'avaient pas identifiée mais qu'ils ont rapidement confirmée. On est loin du gadget. On touche là à un usage vital, au sens propre.

Des promesses… et de sérieuses limites

Cette révolution silencieuse pose évidemment de grosses questions. La première est celle des limites techniques. Les modèles d’IA progressent vite, mais ils restent sujets aux hallucinations — ces réponses fausses, parfois très convaincantes, qui peuvent devenir dramatiques dans un contexte médical. Une erreur dans une recommandation de traitement n’a pas les mêmes conséquences qu’une faute dans un devoir scolaire ou une recherche touristique.

L'autre sujet est celui des précieuses données personnelles de santé. Doit-on tout dire de sa santé à des entreprises privées, américaines de surcroit, sans garanties réelles de respect de la confidentialité ? Dans son annonce, Anthropic précise que les données de santé partagées ne sont ni mémorisées par le modèle, ni utilisées pour l’entraînement futur, et que les autorisations peuvent être modifiées ou révoquées à tout moment.

Vie privée contre vie tout court

Ces affirmations suffisent-elles à rassurer les méfiants pathologiques ? En France, les données de santé sont considérées comme précieuses et jalousement gardées, avec force réglementations et clouds certifiés “SecNumCloud”. Mais se priver des avancées de l'IA en santé parait assurément tragique.

Comme le résumait récemment au micro de Monde Numérique Arnaud Auger, adepte du "bio-hacking" (contrôle de sa santé grâce aux objets connectés et à l'IA) : « entre vie privée et vie tout court, il faut choisir ». C'est à cette question que nous devons répondre aujourd'hui, à la fois individuellement et collectivement.

Partager cet article sur votre réseau préféré :